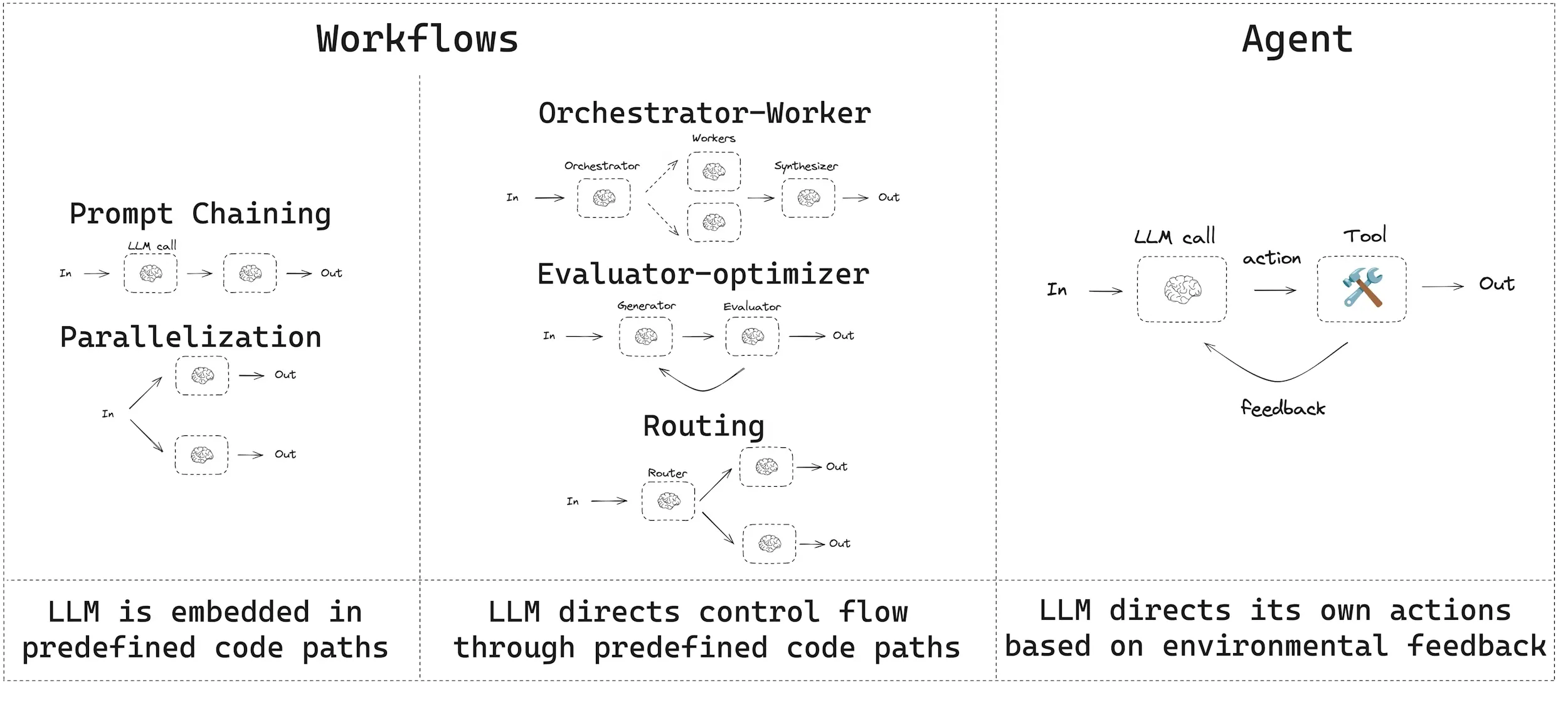

Prompt Chaining、Parallelization、Routing、Orchestrator-worker 与 Evaluator-optimizer 的结构化落地。

用LangGraph实现典型工作模式

这一章介绍常见的工作流和agent模式。

- 工作流具有预设的代码路径,设计上按特定顺序运行。

- 智能体则具备动态性,可自主定义执行流程与工具使用方式。

LangGraph 在构建智能体与工作流时具备多项优势,包括持久化、流式输出,同时支持调试以及部署功能。

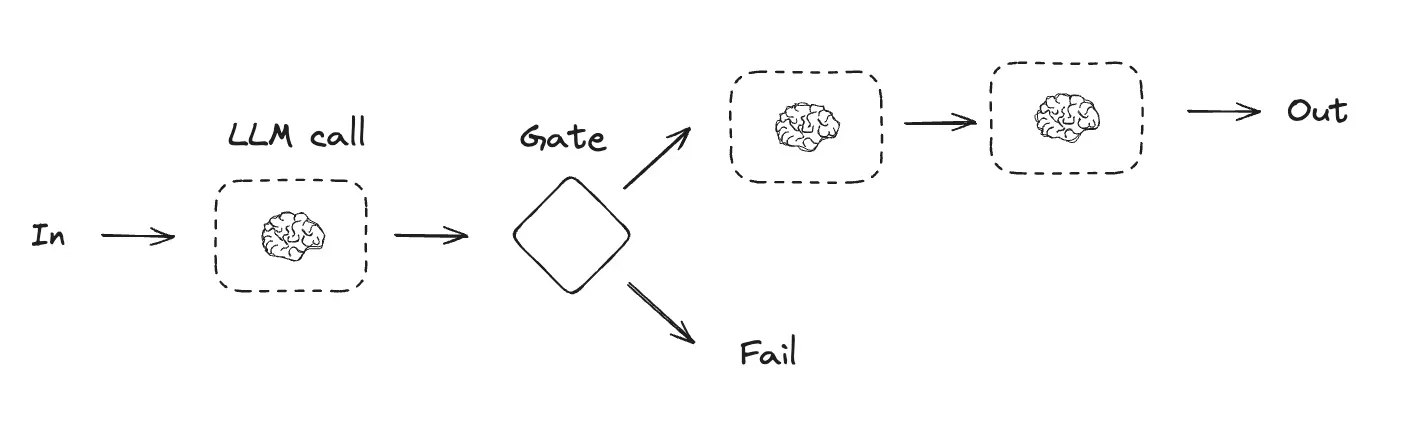

1. Prompt Chaining

提示词链式调用是指每次大语言模型调用都会处理上一次调用的输出结果。它通常用于执行可拆解为更小、可验证步骤的明确任务。例如:

- 将文档翻译成不同语言

- 验证生成内容的一致性

- …

Python3

点击展开代码

展开代码

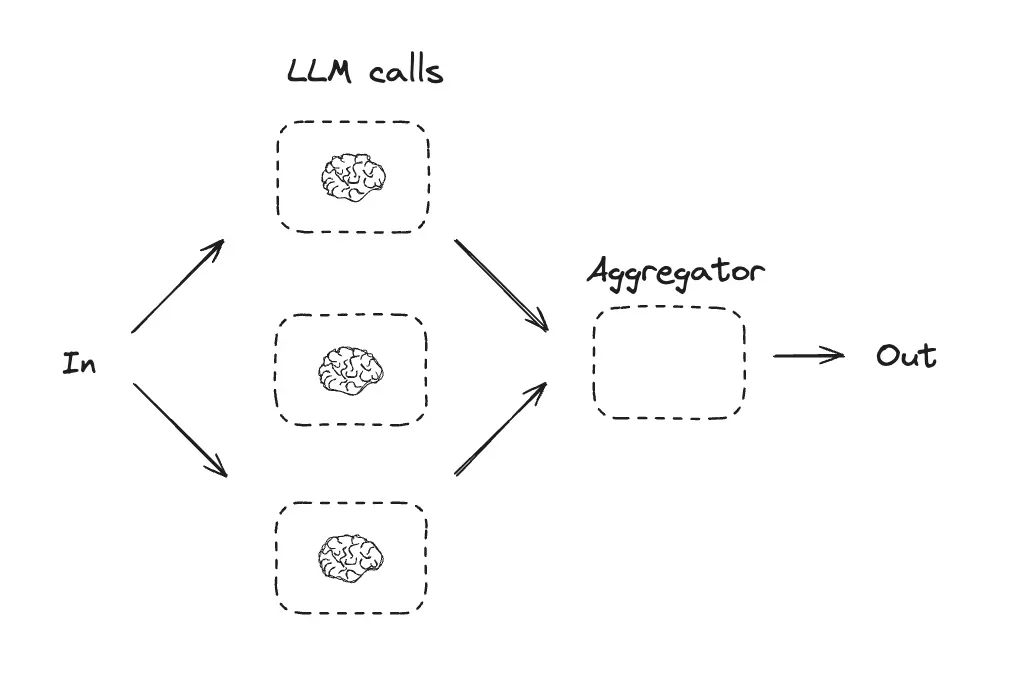

2. Parallelization

借助并行化,大语言模型可同时处理一项任务。实现方式包括同时运行多个独立子任务,或多次运行同一任务以校验不同输出结果。并行化通常用于:

- 拆分子任务并并行执行,从而提升处理速度

- 多次运行任务以校验不同输出结果,从而提高结果可信度

相关示例包括:

- 运行一个子任务提取文档关键词,同时运行另一个子任务检查格式错误

- 多次运行任务,依据不同标准(如引用数量、使用来源数量及来源质量)对文档准确性进行评分

Python3

点击展开代码

展开代码

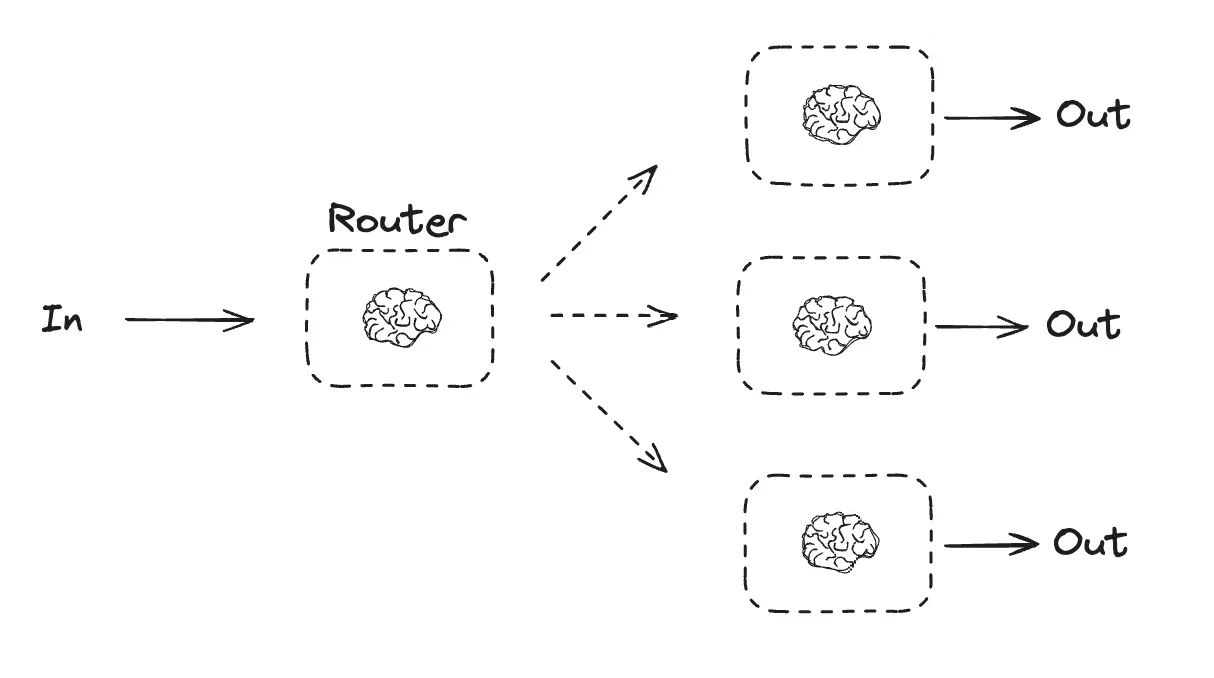

3. Routing

路由工作流会处理输入内容,然后将其导向对应上下文的特定任务。这使你能够为复杂任务定义专用流程。例如,一个用于解答产品相关问题的工作流,可先处理问题类型,再将请求路由至定价、退款、退换货等专属处理流程。

Python3

点击展开代码

展开代码

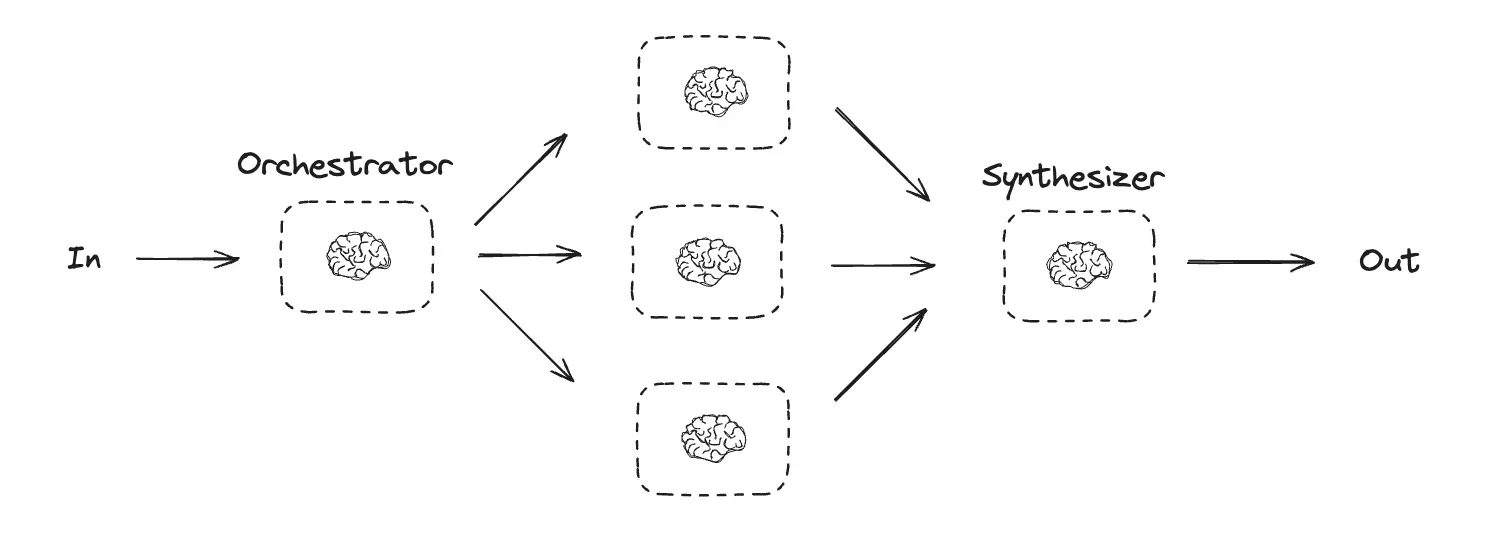

4. Orchestrator-worker

在协调器 - 工作节点架构中,协调器负责:

- 将任务拆解为子任务

- 将子任务分配给工作节点执行

- 整合各工作节点的输出结果形成最终成果

Python3

点击展开代码

展开代码

协调器 - 工作流模式十分常见,LangGraph 已内置对该模式的支持。Send API 可动态创建工作节点并向其发送指定输入。每个工作节点拥有独立状态,所有工作节点的输出都会写入一个共享状态键,协调器图可访问该键。这使得协调器能够获取所有工作节点的输出,并将其整合为最终输出。下面的示例会遍历章节列表,并通过 Send API 将每个章节分发给对应工作节点。

Python3

点击展开代码

展开代码

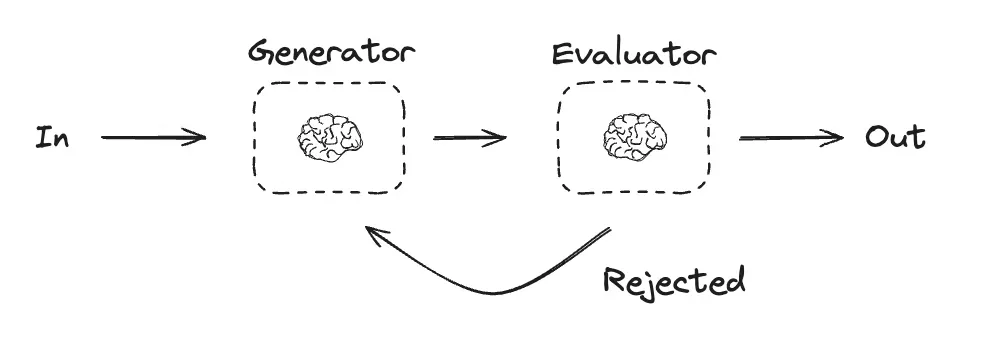

5. Evaluator-optimizer

在评估器 - 优化器工作流中,一个大语言模型生成响应,另一个则对该响应进行评估。若评估器或人工介入环节判定响应需要优化,系统会提供反馈并重新生成响应。该循环持续进行,直至生成符合要求的响应。

评估器 - 优化器工作流常用于任务存在明确成功标准、但需通过迭代才能达标的场景。例如,两种语言间的文本翻译往往难以一次完美匹配,可能需要多次迭代,才能生成语义一致的译文。

Python3

点击展开代码

展开代码

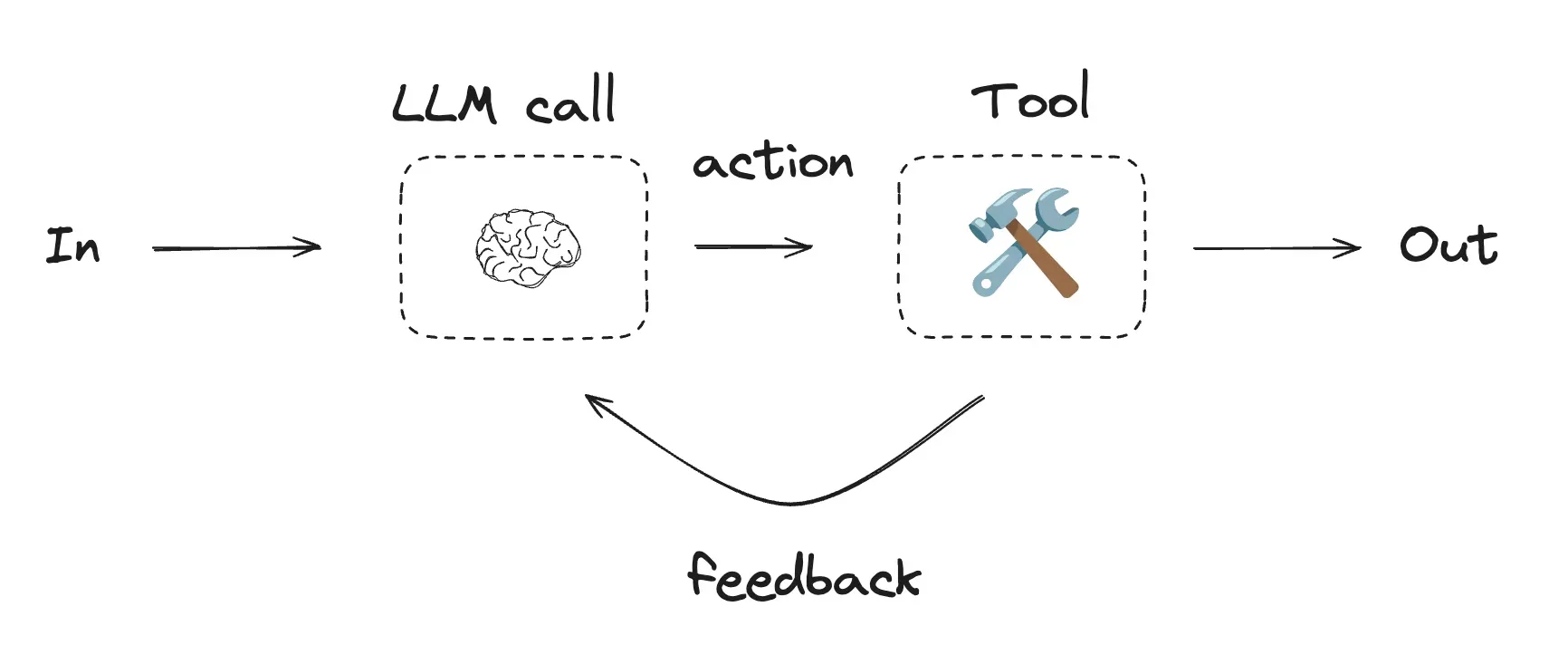

6. Agents

智能体通常由大语言模型实现,通过工具执行操作。它们在持续的反馈循环中运行,适用于问题与解决方案均不可预测的场景。智能体比工作流具有更高的自主性,能够自主决定使用何种工具以及如何解决问题。你仍可定义可用的工具集及智能体的行为准则。

Python3

点击展开代码

展开代码

专题阅读

LangGraph

这篇文章属于同一条阅读链。你可以直接在这里切换,不用再回到列表页重新找。

部分信息可能已经过时

留言区

留言

欢迎纠错、补充、交流。昵称和评论内容必填;如果你愿意,也可以留下联系方式,仅站主可见。