318 字

1 分钟

Reinforce Learningreinforce learning

Off-Policy 偏好优化:DPO 与新分支

从 PPO 的最优解视角回看偏好优化,理解 DPO 为什么能绕过显式奖励模型与强化学习流程。

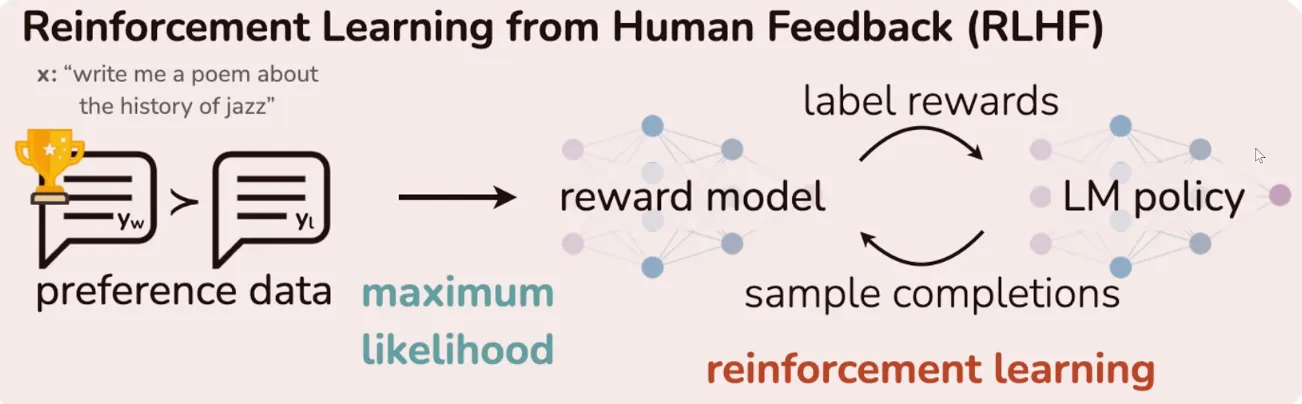

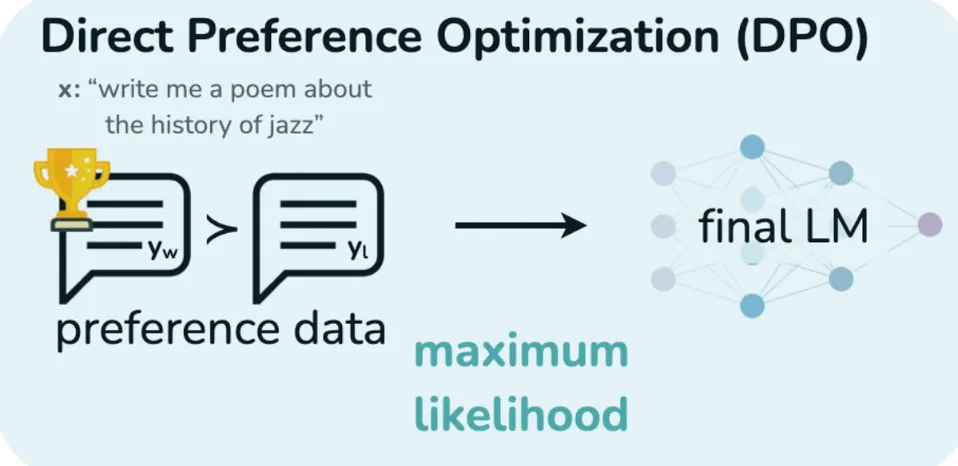

DPO算法是对PPO的流程进一步简化,

一. 直接偏好优化 (Direct Preference Optimization, DPO)

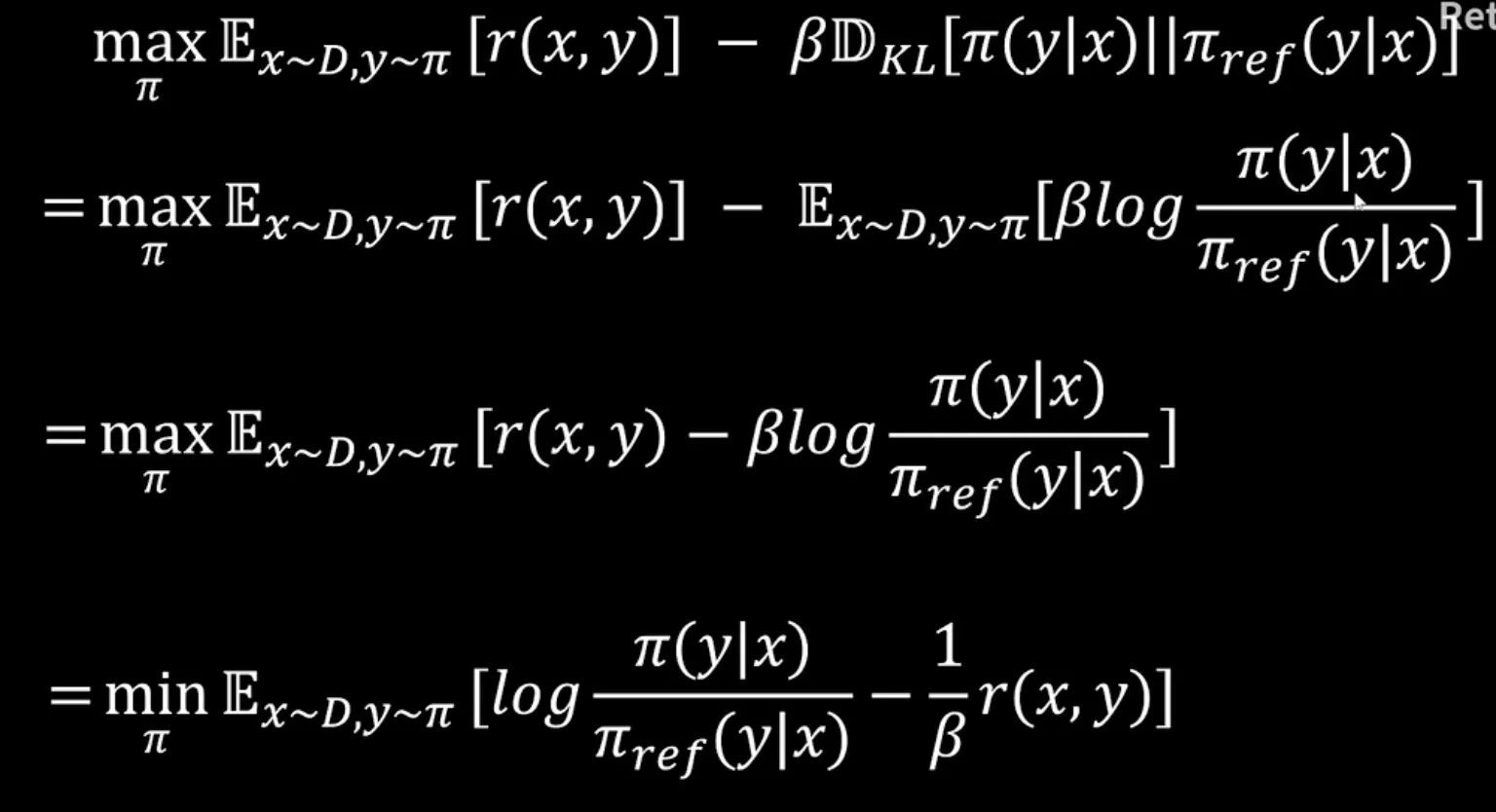

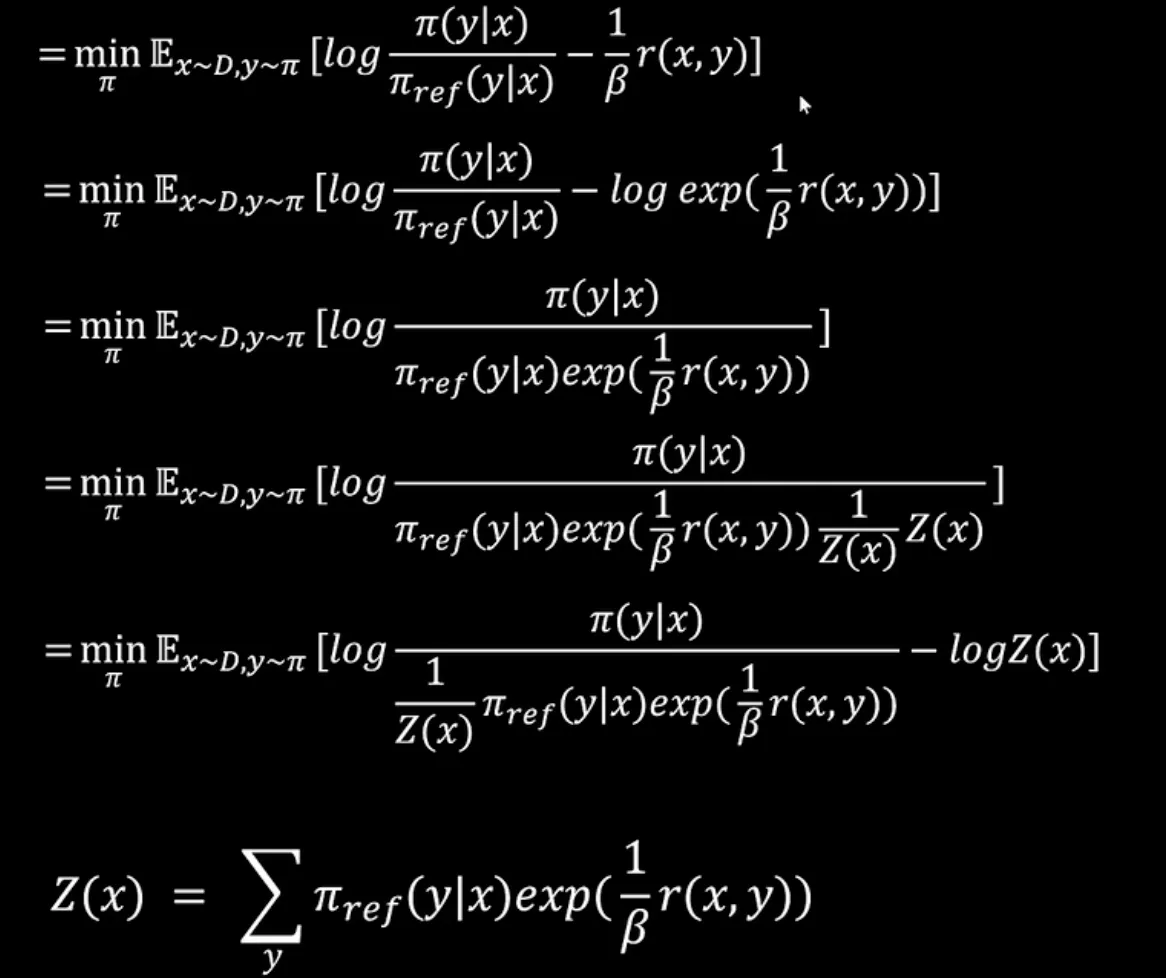

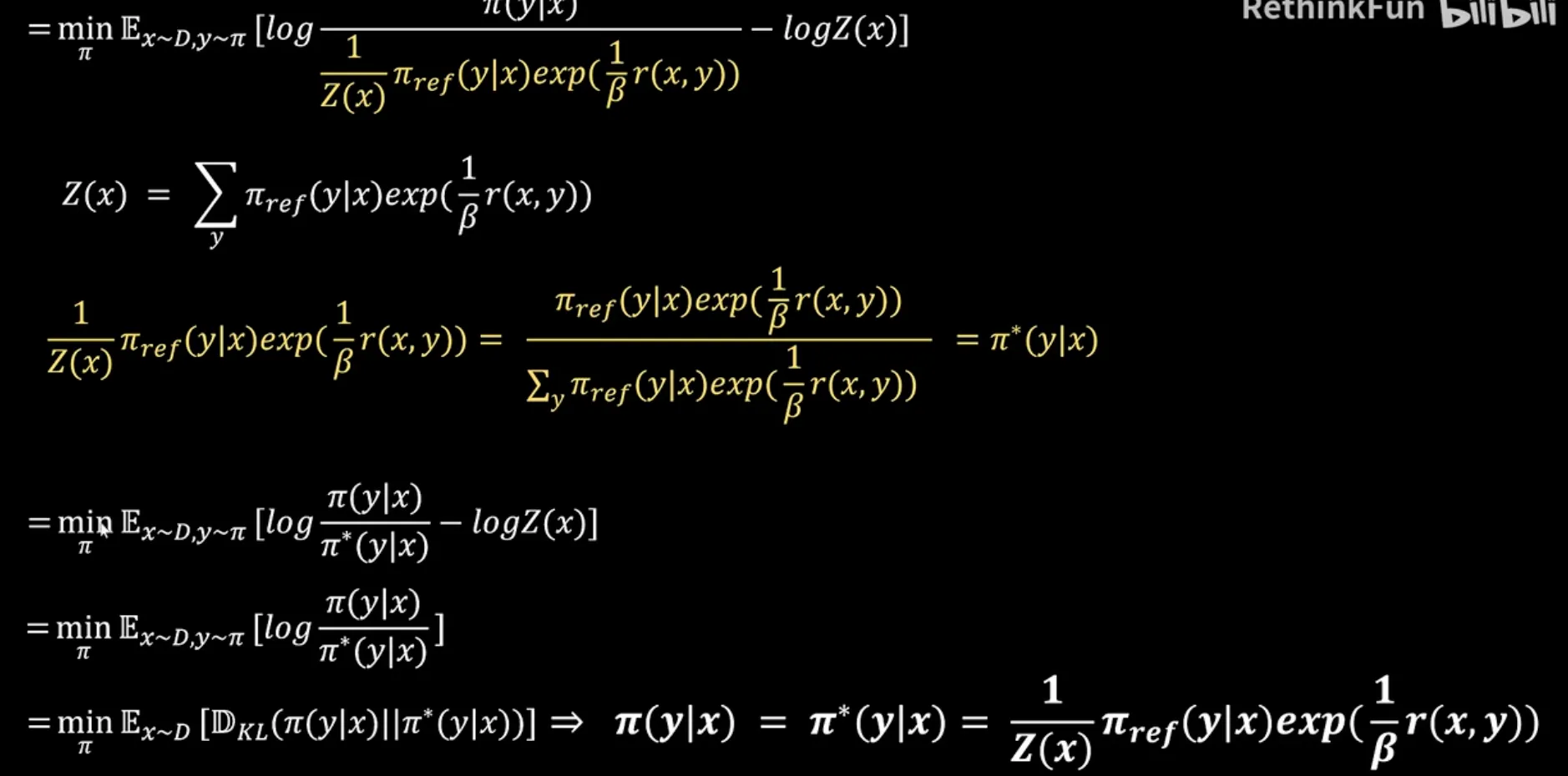

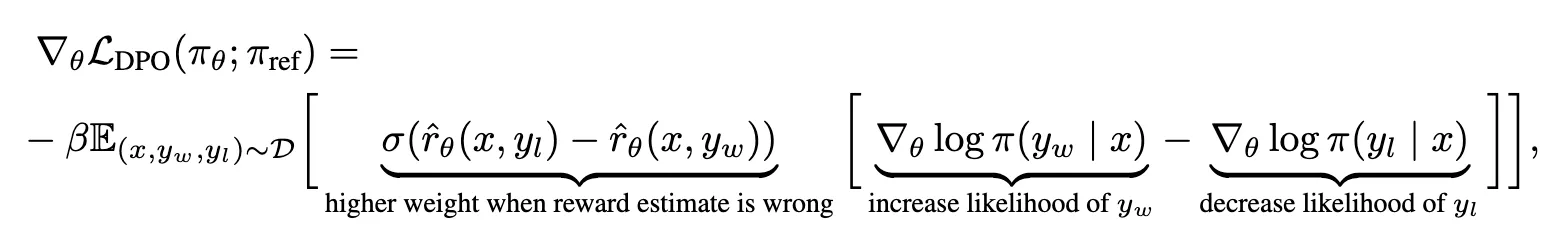

以PPO为优化目标产生最优Policy的条件下推出了reward的表达式, 然后将该reward的表达式代入了以Bradley-Terry模型建模的最大似然估计中, 即可得到DPO的Loss. (DPO与PPO的目标是一致的,PPO以强化学习的方式实现了这个目标的优化,DPO认为这个目标有一个解析解,所以把这个解析解推导了出来,最后得到了DPO的loss)

DPO的核心洞察在于原始强化学习问题存在解析最优解,表明最优策略与奖励函数存在一一映射关系。DPO将此关系反解后代入Bradley-Terry偏好模型,将对奖励函数的似然最大化,等价地转化为直接对策略的似然最大化。因此,优化DPO损失函数即是在直接寻找那个能同时最大化人类偏好概率且满足最优解形式的策略,避免了先用偏好数据拟合奖励模型再进行强化学习过程寻找最优策略.

专题阅读

Reinforce Learning

这篇文章属于同一条阅读链。你可以直接在这里切换,不用再回到列表页重新找。

当前进度8 / 10

01

强化学习学习路线图:从 RL 基础到对齐训练

更新于 2026-04-01

02强化学习入门:为什么需要 RL、术语与 MDP

更新于 2026-03-31

03免模型强化学习:DP、MC、TD、SARSA 与 Q-learning

更新于 2026-03-30

04从表格到函数:DQN 与 Value-Based 深度强化学习

更新于 2026-03-29

05策略梯度入门:从定理到 REINFORCE

更新于 2026-03-28

06Actor-Critic 主线:优势函数、GAE、TRPO 与 PPO

更新于 2026-03-27

07LLM 对齐训练:RLHF、奖励模型与规则化分支

更新于 2026-03-26

08Off-Policy 偏好优化:DPO 与新分支

更新于 2026-03-25

当前

09可验证强化学习:RLVR 与 Tülu 3

更新于 2026-03-24

10RLHF 奠基论文:Helpful & Harmless Assistant 速记

更新于 2026-03-23

部分信息可能已经过时

留言区

留言

欢迎纠错、补充、交流。昵称和评论内容必填;如果你愿意,也可以留下联系方式,仅站主可见。